Bing Webmaster Tools zeigen seit Februar 2026, wie oft Inhalte einer Website in KI-Antworten als Quelle zitiert werden. Der neue AI Performance Report ist der erste Schritt aus der Blackbox KI-Sichtbarkeit. Erstmals sehen Website-Betreiber, welche Seiten von Microsoft Copilot als Grundlage für Antworten herangezogen werden. Das ist ein echter Fortschritt, bisher gab es dafür keine Daten.

Aber die Zahlen allein erzählen nicht die ganze Geschichte. In meiner Arbeit als GEO-Strategin analysiere ich regelmäßig, wie KI-Systeme über Unternehmen sprechen. Dabei zeigt sich ein Muster, das im AI Performance Report nicht sichtbar wird: Eine hohe Citation-Zahl bedeutet nicht, dass das Unternehmen auch empfohlen wird.

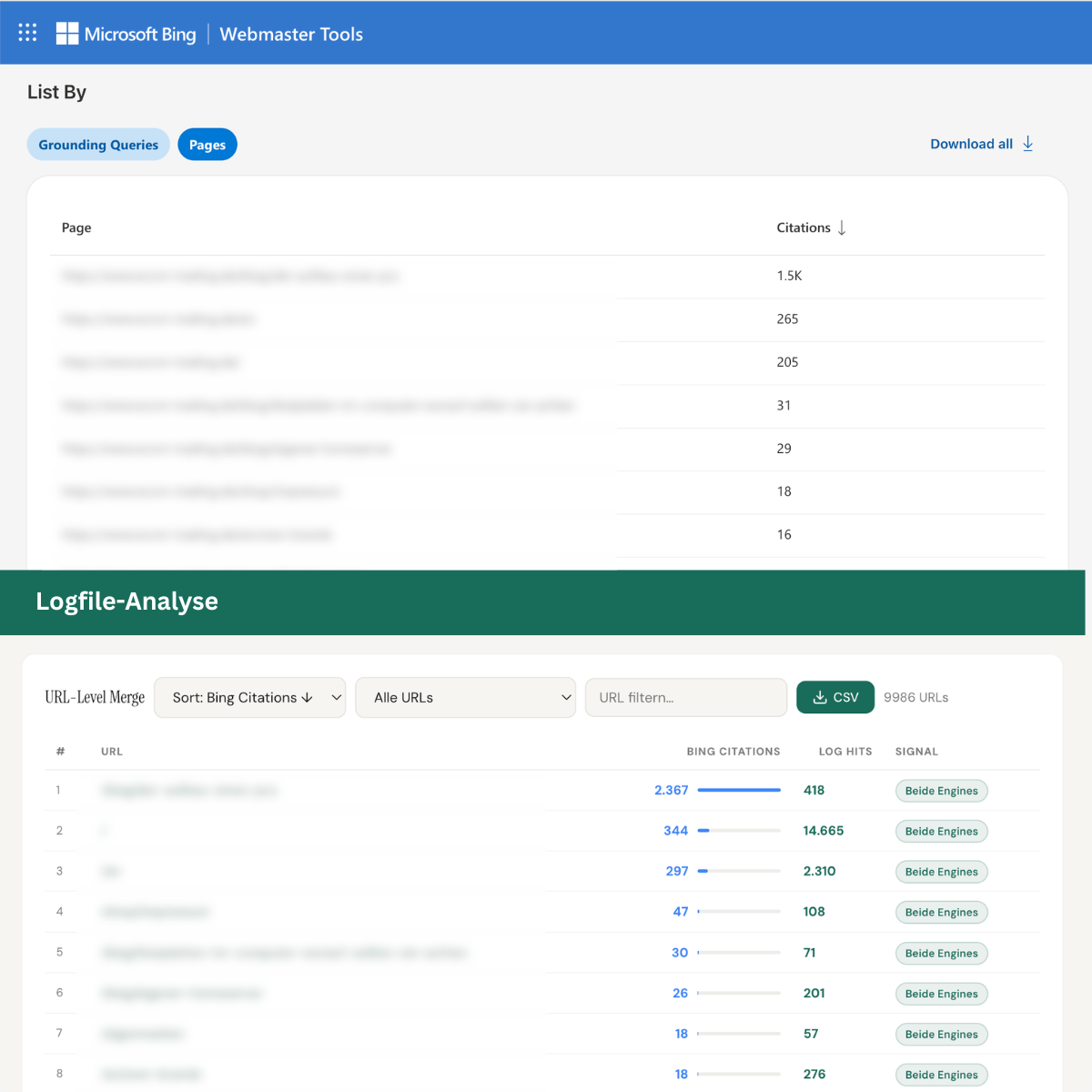

Sigrid Holzners Analyse von KI-Citations: Der Bing AI Performance Report zeigt erstmals, welche Seiten von Microsoft Copilot zitiert werden. Aber zitiert ist nicht empfohlen. Bei einer Website gingen über 2.000 Citations auf einen Ratgeber-Artikel, der Markenname fiel in der Copilot-Antwort nicht. Prüfbar über einen manuellen Copilot-Test und den Abgleich mit Server-Logfiles und GA4.

Was ist eine Citation? Was ist eine Empfehlung?

Eine Citation (Zitation) im Kontext von KI-Sichtbarkeit bedeutet: Ein KI-System wie Microsoft Copilot hat den Inhalt einer Webseite gelesen und als Grundlage für seine Antwort verwendet. Der Content dient als Wissensquelle im Hintergrund. Der Nutzer bekommt eine fundierte Antwort, erfährt aber nicht, von welchem Unternehmen der Inhalt stammt.

Eine Empfehlung bedeutet: Das KI-System nennt das Unternehmen namentlich als Lösung für ein konkretes Anliegen. Statt „Ein PC besteht aus folgenden Komponenten…“ antwortet Copilot mit „Bei [Unternehmen] finden Sie diese Komponenten einzeln oder als fertiges System.“

Die Citation bringt dem Nutzer eine Antwort. Die Empfehlung bringt dem Unternehmen einen Kontakt.

Beides hat Wert. Aber nur eines davon hat direkten Geschäftswert. In der Generative Engine Optimization (GEO), also der Optimierung von Webinhalten für KI-basierte Antwortmaschinen, ist dieser Unterschied zentral.

Sigrid Holzner prüft in jedem GEO-Audit, ob Citations zu Empfehlungen werden.

Was ist GEO und warum ist der Unterschied relevant?

Generative Engine Optimization (GEO) ist die Optimierung von Webinhalten für KI-basierte Antwortmaschinen wie ChatGPT, Microsoft Copilot, Google AI Mode und Perplexity. Während klassisches SEO auf Rankings in Suchergebnissen abzielt, optimiert GEO dafür, dass Inhalte von KI-Systemen als Quelle herangezogen und das Unternehmen als Lösung empfohlen wird. GEO umfasst unter anderem semantisches HTML, Content Chunks, Schema Markup und Entity-Verankerung.

Die Unterscheidung zwischen Citation und Empfehlung ist für GEO entscheidend: Viele Unternehmen optimieren ihren Content so, dass KI-Systeme ihn als Wissensquelle nutzen. Aber solange der Markenname nicht im zitierten Absatz steht, bleibt das Unternehmen in der KI-Antwort unsichtbar. Mehr zu den sechs Ebenen der GEO-Optimierung auf meiner Startseite.

Was der Bing AI Performance Report zeigt und was nicht

Der AI Performance Report in den Bing Webmaster Tools liefert drei Datenpunkte: Die Gesamtzahl der Citations (wie oft wurde Content von der eigenen Website in KI-Antworten als Quelle verwendet), die zitierten Seiten (welche URLs am häufigsten herangezogen werden) und die sogenannten Grounding Queries.

Grounding Queries sind die internen Suchphrasen, die Microsoft Copilot verwendet, um Webinhalte für eine Antwort abzurufen. Grounding Queries sind nicht identisch mit der Frage, die der Nutzer gestellt hat. Copilot zerlegt komplexe Nutzeranfragen in kürzere, gezieltere Suchphrasen. Wenn ein Nutzer zum Beispiel fragt „Wie baue ich einen PC zusammen und was brauche ich dafür?“, könnte die Grounding Query „aufbau eines pcs“ lauten.

Was der Report nicht zeigt: ob der Markenname des Unternehmens in der Copilot-Antwort vorkommt. Der AI Performance Report enthält keine Klickdaten, keine Information darüber, ob Nutzer von der KI-Antwort auf die Website weitergeleitet werden, und keine Angabe, ob eine Citation zu einer namentlichen Erwähnung geführt hat.

So prüft man den Unterschied

Ein einfacher manueller Test reicht aus: Im AI Performance Report die meistzitierten Seiten und die zugehörigen Grounding Queries identifizieren. Dann die Grounding Queries direkt in Microsoft Copilot eingeben, jeweils in einem neuen Chat, ohne vorherigen Kontext. Und dann prüfen: Kommt der eigene Markenname in der Antwort vor?

Wer zusätzlich Server-Logfiles auswertet, kann den sogenannten ChatGPT-User Bot identifizieren. Dieser Bot wird von OpenAI geschickt, wenn ein echter Nutzer in ChatGPT eine Frage stellt und das Modell eine Seite live abruft, um die Antwort zu formulieren. Jeder ChatGPT-User Zugriff in den Logfiles ist ein direkter Hinweis darauf, dass der Inhalt für eine KI-Antwort herangezogen wurde. In Kombination mit GA4-Daten lässt sich so prüfen, ob von den Citations auch messbarer Traffic auf der Seite ankommt. Mehr dazu, wie ich KI-Traffic systematisch tracke, beschreibe ich im Artikel GEO-Monitoring: Was ich nach 9 Monaten ChatGPT-Tracking gelernt habe.

Was ich in der Praxis beobachtet habe

Bei einer Site, die ich im Rahmen einer GEO-Analyse untersucht habe, zeigte der Bing AI Performance Report über 3.000 Citations in drei Monaten. Das klingt nach starker KI-Sichtbarkeit. Bei genauerem Hinsehen entfielen fast 70% dieser Citations auf einen einzigen Ratgeber-Artikel, über 2.000 Mal zitiert.

Der manuelle Copilot-Test zeigte: Copilot nutzte den Ratgeber-Artikel ausführlich, um Fragen rund um das Thema zu beantworten. Der Markenname des Unternehmens fiel in der Copilot-Antwort nicht.

Der Gegencheck über Server-Logfiles und GA4 untermauerte das Bild: Von den über 2.000 Citations auf den Ratgeber-Artikel kam kaum messbarer Traffic auf der Website an. Die KI bediente sich am Content, der Nutzer bekam seine Antwort, und das Unternehmen ging leer aus.

Warum Ratgeber-Inhalte besonders anfällig sind

Ratgeber-Artikel und informationelle Inhalte sind für KI-Systeme ideales Grounding-Material. Ratgeber-Content ist gut strukturiert, faktenbasiert und klar formuliert, Eigenschaften, die auch guten SEO-Content ausmachen. Aber Ratgeber beantworten Fragen, ohne das eigene Angebot als Lösung zu positionieren. Für die KI ist Ratgeber-Content eine perfekte Wissensquelle. Für das Unternehmen ist Ratgeber-Content ohne Brand-Verankerung eine verpasste Chance.

Das Muster dürfte häufig vorkommen: Unternehmen mit gutem Ratgeber-Content, die in KI-Antworten als Wissensquelle auftauchen, ohne dass der Markenname fällt. Besonders betroffen sind Seiten, die über Themen informieren, die das Unternehmen selbst als Dienstleistung oder Produkt anbietet, aber diese Verbindung im Content nicht herstellen.

Was man tun kann

Die gute Nachricht: Wenn eine Seite bereits als Wissensquelle zitiert wird, ist der schwierigste Teil geschafft. Das KI-System vertraut dem Inhalt. Was fehlt, ist die Brücke vom Wissen zum Angebot.

Konkret heißt das: Im zitierfähigen Absatz, also dem Textblock, den Copilot als Grundlage für seine Antwort heranzieht, sollte eine natürliche Verbindung zum eigenen Angebot stehen. Kein plumper Werbetext, sondern ein Satz, der dem Leser (und der KI) zeigt: Das Unternehmen hinter diesem Wissen bietet auch die Lösung an.

Im konkreten Fall fehlte im Schlussabsatz des Ratgeber-Artikels ein einziger Satz, der das Angebot mit dem Inhalt verbindet. Nach der Anpassung hat Copilot bei Folgefragen die Möglichkeit, die Verbindung zum Brand herzustellen. Ob diese Anpassung in der Praxis funktioniert, teste ich gerade. Ein Fall, keine allgemeingültige Studie.

Häufige Fragen

Was ist der Unterschied zwischen einer KI-Citation und einer Empfehlung?

Was ist eine Grounding Query im Bing AI Performance Report?

Wie prüfe ich, ob mein Unternehmen in KI-Antworten empfohlen oder nur zitiert wird?

Was ist Generative Engine Optimization (GEO)?

Sie möchten wissen, ob Ihre Website in KI-Antworten zitiert oder empfohlen wird?